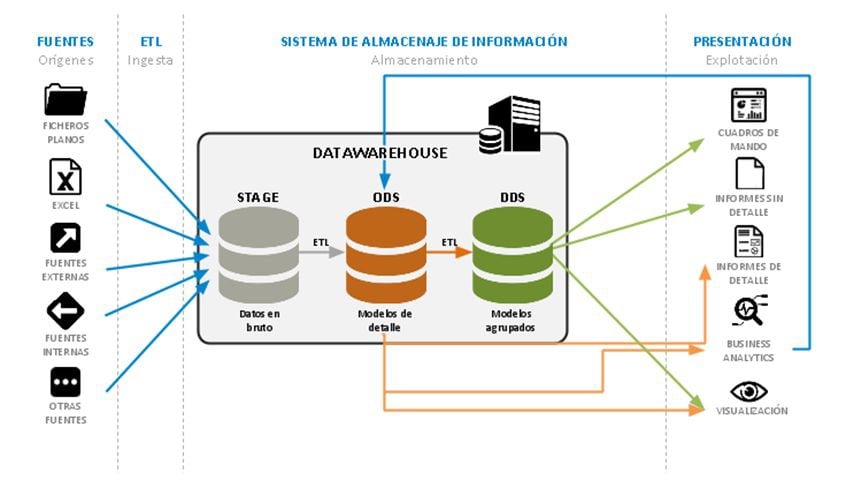

La arquitectura de un Data Warehouse está encaminada a realizar una transformación y clasificación de datos en un Data Warehouse y sus respectivos Data Mart. Cada Data Warehouse presenta una arquitectura estándar que le permite proponer a su vez una arquitectura de almacenamiento más organizada y una arquitectura de datos estructurada.

La arquitectura de un Data Warehouse es muy usada en el Business Intelligence BI para planificar estrategias de negocios, ya que un Data Warehouse dispuesto correctamente va a permitir una ventaja competitiva en el mercado creada por medio de la toma de decisiones estratégicas.

¿Cómo se monta un Data Warehouse?

Arquitectura de un Data Warehouse

La arquitectura de un data warehouse wallpaper está estructurada de tal modo que tenemos un montón de fuentes; con estas fuentes, a través de procesos ETL (Extract, Transform, Load), esos orígenes que se tenían y no eran propios se van trasladar y a cargar en una base de datos propia dentro del Data Warehouse. Esa área donde se cargan los datos es denominada stage y, normalmente, allí se encuentran los datos en bruto. No se hace nada con los datos, simplemente se copian y se pegan desde los sistemas operacionales.

Una vez se tiene todo en el stage, empieza el trabajo del analista de datos en ODS (Operational Data Store u ods dds ). En ODS se modelizan absolutamente todos los datos que hayan sido ingresados al stage: se revisa que no haya islas de información, se ejecuta la parte del data quality, etc.

En ODS lo que hace es adaptar los datos al negocio, hacer un análisis de datos que permita crear un Data Warehouse que corrobore que los usuarios finales pueden acceder o complementar dichos datos.

Como en el stage suele haber un volumen de datos mucho mayor que en otro tipo de arquitecturas de almacenamiento, este se organiza por medio de los modelos en estrella y copo de nieve.

Cuando los datos ya se encuentran en el Data Warehouse, pueden agruparse en un DDS (Dimensional Data Store) o almacén de datos, que se orienta más al usuario, en donde la información se muestra y los datos se organizan en un modelo dimensional que admite consultas analíticas.

Procesos ETL

Los procesos ETL forman parte de la arquitectura de un data warehouse y van encaminados a realizar una integración de datos. Se usan para extraer información de determinadas fuentes. La traducción de la sigla al español es «Extracción, transformación y carga» y cada letra representa un subproceso dentro de los procesos ETL.

Extract (Extracción)

Esta es la primera fase de los procesos ETL, que forman parte de la arquitectura de un Data Warehouse. Aquí se reúnen los datos de distintas fuentes, como un CRM o un ERP. Estos son solo ejemplos, ya que aquí se extrae todo tipo de información.

Es importante tener información acerca de los datos que se van a extraer, ya que su formato y características esenciales van a ayudar a definir cuál es el mejor modo de extracción y van a permitir que los datos se puedan clasificar mejor posteriormente.

Tras la extracción, se hace un análisis e interpretación de los datos obtenidos para pasar ya a la segunda fase.

Transform (Transformación)

En esta segunda fase del proceso ETL de la arquitectura de data warehouse se aplica lo que se denominan reglas de negocio, en las cuales se realizan todo tipo de procesos, como filtrado, cálculos, enlazado y modelado de datos, entre muchos otros.

Esta fase es indispensable en la estrategia de negocio, ya que es la que le brinda validez, por decirlo de algún modo, a los datos.

Load (Carga)

En esta fase final del proceso ETL de la arquitectura de un Data Warehouse, los datos producto de la transformación se cargan en el sistema de destino, es decir, en el stage. El proceso de carga puede comprender una serie de acciones y esto va a depender de las necesidades organizacionales.

Stage

Un stage o staging area es el sistema existente entre las fuentes de datos y el Data Warehouse. Forma parte de la arquitectura de un Data Warehouse y tiene como objetivo mejorar la calidad de los datos que ingresan al DWH por medio de una especie de tratamiento previo que se les da.

¿Y qué sigue?

Como ya has visto, la arquitectura de un Data Warehouse está compuesta por una serie de procesos con una alta complejidad. El trabajo del analista es cumplir todos esos procesos y entregar los datos al usuario final en una presentación adecuada para su visualización (cuadros de mando, informes, business analytics, etc).

Si quieres seguir aprendiendo sobre este tema y otros tantos de analalítica de datos, te invitamos a que realices nuestro Big Data, Inteligencia Artificial & Machine Learning Full Stack Bootcamp. ¡Te convertirás en un experto en muy poco tiempo!