Prepárate porque este artículo está dedicado a mostrarte un práctico ejemplo de word embedding, así explorarás cómo estos espacios vectoriales capturan y representan el significado y la relación entre términos, ofreciéndonos una comprensión más profunda y aplicaciones sorprendentes en el mundo tecnológico.

Word embedding y espacios vectoriales

En el machine learning, los espacios vectoriales cumplen un papel fundamental, especialmente en el procesamiento del lenguaje natural a través de los word embeddings. Estos no son más que una técnica avanzada donde palabras y frases se transforman en vectores de números, creando así un «embedding space» o espacio vectorial que captura la esencia del lenguaje de una manera que las máquinas pueden procesar. Sin embargo, el potencial de los espacios vectoriales va mucho más allá de las palabras: desde documentos hasta imágenes, cualquier tipo de dato puede ser convertido en vectores, abriendo un universo de posibilidades para análisis y aplicaciones más complejas.

Por ejemplo, imagina que tienes una tienda de ropa; podrías mapear los vestidos a un espacio vectorial de dimensiones n y luego recomendarle a un cliente los vestidos más parecidos a los que le gustan (empleando cosine similarity, por ejemplo).

¿A qué nos referimos con un espacio vectorial de dimensiones n? Básicamente, son features del modelo que estamos creando. Sería así:

- Personas: edad, peso, altura, color del pelo, color de ojos…

- Casas: número de habitaciones, precio de venta, año de construcción…

- Coches: velocidad máxima, tiempo de aceleración, precio…

El número de dimensiones lo defines tú cuando estás creando el modelo.

Ejemplo de word embedding

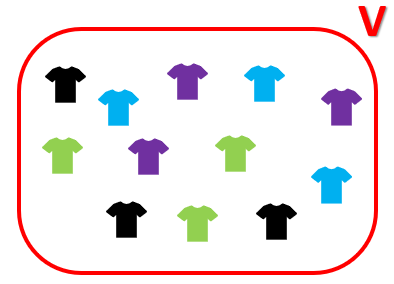

Para explicarte el ejemplo de word embedding continuaremos con la tienda de ropa. Piensa que en tu tienda de ropa se te ocurre la idea de categorizar o identificar la ropa usando un vector. Tienes, por tanto, una serie de prendas de vestir que son distintas una de la otra, ya que cada una es de un color distinto.

Entonces, lo que quieres es clasificar la ropa de tal modo que puedas decir que cada categoría tiene x o n características.

¿Qué tipo de propiedades podríamos extraer de la ropa para identificarla? Podría ser:

- Talla.

- Tejido.

- Color.

- Estampados.

- Marca.

En este ejemplo de word embedding vamos a usar todas estas propiedades para definir cada una de las prendas de vestir que tengamos en la tienda.

Aquí es donde usaremos la definición de espacio vectorial. En nuestro espacio vectorial tendríamos, una serie de misceláneas de prendas de vestir de distintas marcas, colores, tallajes, etc.

Todo el espacio vectorial va a tener las mismas propiedades, y todas las prendas van a medirse utilizando las mismas propiedades.

El siguiente paso en nuestro ejemplo de word embedding será coger cada prenda de ropa y generar un vector para identificarla.

Así, tenemos la camiseta 1, la camiseta 2 y la camiseta n.

- Camiseta 1: [(talla) 40, (tejido) pana, (color) azul, (estampado) no, (marca) Adidas]

- Camiseta 2: [39, algodón, verde, sí, Puma]

Sucesivamente, lo tienes que hacer con todas las camisetas.

Al final, cada prenda va a tener un vector. Ese vector no es más que una secuencia de valores (en este caso), y esa secuencia de valores hace referencia a las propiedades que tenemos.

Ya hemos visto que los ordenadores y los algoritmos no son buenos trabajando con strings, por lo tanto, el siguiente paso en nuestro ejemplo de word embedding es convertir los valores string que tenemos en numéricos. De modo que:

- Camiseta 1: [(talla) 40, (tejido) pana → 1, (color) azul → 20, (estampado) no → 0, (marca) Adidas → 1570]

- Camiseta 2: [39, algodón → 5, verde → 65, sí → 1, Puma → 322]

Aquí ya tenemos dos vectores. Ahora la pregunta es: ¿qué podríamos hacer? Podríamos calcular la similitud.

- Entonces, ¿cuál es la importancia del espacio vectorial? El espacio vectorial nos proporciona una herramienta matemática muy útil para definir ciertas propiedades para poder crear vectores en los que cada uno de ellos va a tener las mismas propiedades, lo que nos ayudará a generar, calcular o realizar ciertas operaciones, entre ellas la similitud entre vectores.

Así pues, en este ejemplo concreto, gracias a este mecanismo y con una lógica tan sencilla como la que hemos seguido, podríamos generar un catálogo tremendamente enorme de ropa simplemente midiendo las propiedades de la ropa que ya teníamos.

Ahora que hemos visto un ejemplo de word embedding, puedes seguir aprendiendo sobre Big Data. Si te gustaría acceder a una de las disciplinas más demandadas y mejor pagadas en todo el mercado laboral, no te pierdas el Big Data, Inteligencia Artificial & Machine Learning Full Stack Bootcamp, una formación intensiva e íntegra en la que adquirirás, en pocos meses, todos los conocimientos que te ayudarán a lograr el trabajo de tus sueños. ¡Entra ya para solicitar información y anímate a cambiar tu vida!