Las queries simples de Hive se establecen como un saber fundamental para el manejo de los macrodatos en Hive. De hecho, de manera general, saber cómo funcionan las queries simples de Hive es un conocimiento básico dentro del universo de herramientas, sistemas y lenguajes para el manejo del Big Data.

Desde KeepCoding reconocemos su importancia para los procesos de consulta y respuesta en los servidores de búsqueda para los macrodatos. Por ello, en este post, te traemos un acercamiento preciso a las queries simples de Hive y su importancia dentro del mundo Big Data.

¿Qué es Apache Hive?

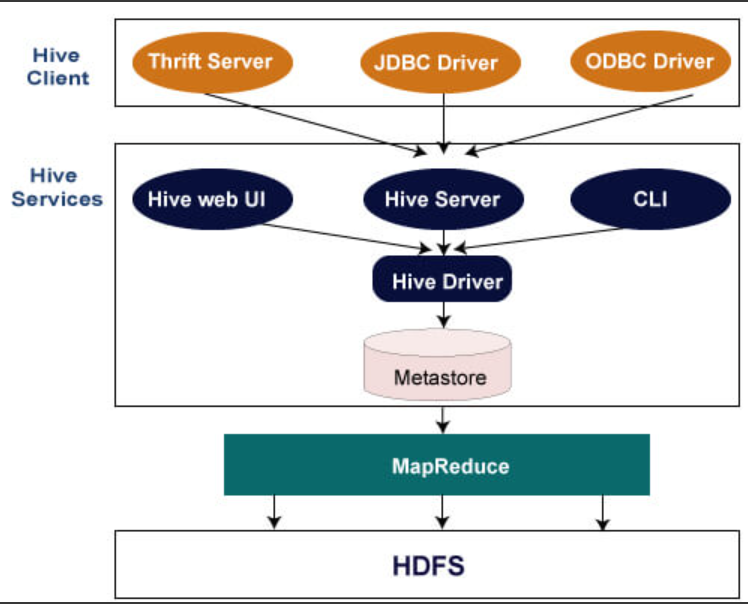

Apache Hive es una infraestructura de Data Warehousing y ETL (extraer, transformar, cargar) construida para funcionar sobre Hadoop. Se halla, específicamente, sobre el componente de HDFS (Hadoop Data File System) y YARN (Yet Another Resource Negociator).

Por otra parte, una de sus ventajas radica en que al usar esta herramienta se asegura efectividad en sus tres tareas principales para llevar a cabo la gestión de los datos:

- Análisis tipo SQL de datasets muy grandes: esta es su tarea principal, puesto que es la que permite que se lleve a cabo la gestión de una gran volumen de datos.

- Queries Ad-Hoc: Apache Hive te permite hacer queries que se desarrollan de forma espontánea.

- Encapsulamiento de datos: en Apache Hive contarás con un proceso que añade los datos en paquetes para facilitar la solución de las peticiones.

Por otra parte, Hive puede compararse con cualquier arquitectura de sistemas de SQL, puesto que cuenta con layer de servidor que administra el acceso a tablas, disco, permisos de usuarios, a los esquemas, etc. Por último, en Apache Hive hallarás otro layer, el cliente, que te permite conectar al servidor y ejecutar queries, entre otras cosas.

¿Cuáles son las Queries simples de Hive?

Ahora, a continuación, te compartimos cuáles son las principales queries simples que podrás desarrollar dentro lo que es Hive:

Para «Mostrar tablas»

- show tables;

Para «Crear tabla»

- CREATE TABLE alumnos (id INT, name STRING, last_name STRING);

Para «Insertar datos»

- INSERT INTO alumnos values(1, ‘ricardo’, ‘vegas’), (2, ‘pedro’, ‘perez’);

- INSERT INTO alumnos values(3, ‘maria’, ‘ochoa’), (4, ‘mario’, ‘gomez’);

Queries

También podrás extraer «Queries» de la siguiente forma:

- SELECT * from alumnos;

Insertar muchos datos

Ahora, para insertar muchos datos, deberás seguir los siguientes pasos:

- ctrl+c (salir de beeline)

- apt update

- apt install nano -y

- nano profesores.csv

A partir de allí, debes llenar con:

- 1,maria,vargas,mates

- 2,julio,perez,fisica

- 3,sandra,martinez,quimica

Teclear [ctr]x + y + enter para salir de vim, y luego ejecutar el siguiente comando:

- /opt/hive/bin/beeline -u jdbc:hive2://localhost:10000

- CREATE TABLE profesores (id INT, name STRING, last_name STRING, asignatura STRING) ROW FORMAT DELIMITED FIELDS TERMINATED BY ‘,’;

- LOAD DATA LOCAL INPATH ‘/opt/profesores.csv’ INTO TABLE profesores;

- SELECT * from profesores;

El delimitador por defecto en Hive es un carácter de ASCII (Código Estadounidense Estándar para el Intercambio de Información) no estándar (^A). Por lo tanto, si quieres importar un CSV (Comma Separated Values) tendrás que crear una tabla indicando el delimitador.

Insertar desde HDFS (Hadoop Distributed File System)

Para insertar desde HDFS (Hadoop Distributed File System), tendrás que ejecutar:

- LOAD DATA INPATH ‘PATH_DE_HDFS_CON_DATOS’ OVERWRITE INTO TABLE alumnos;

Extraer datos a HDFS

Para ello, como parte de queries simples de Hive, deberás ejecutar en la consola, el siguiente comando:

INSERT OVERWRITE DIRECTORY ‘output’ SELECT * FROM profesores;

- ctrl+c

- hdfs dfs -ls -R

- hdfs dfs -cat output/*

Ten en cuenta que seguramente el delimitador no se despliegue correctamente. En caso de que esto suceda, debes indicar de nuevo el delimitador en la query de la siguiente forma:

INSERT OVERWRITE DIRECTORY ‘output’ ROW FORMAT DELIMITED FIELDS TERMINATED BY ‘,’ SELECT * FROM profesores;

- hdfs dfs -cat output/*

Su importancia dentro del mundo Big Data

Dentro del mundo del Big Data, las queries simples de Hive son relevantes gracias a su capacidad de llevar a cabo determinadas consultas de manera efectiva.

En suma, gracias a las queries simples de Hive también podrás llevar a cabo extracciones hacia segmentos de Google Storage. Para ello, deberás sustituir las siguientes XXXX con el nombre del segmento en la consola, así:

- INSERT OVERWRITE DIRECTORY ‘gs://XXXXXX/output’ ROW FORMAT DELIMITED FIELDS TERMINATED BY ‘,’ SELECT * FROM alumnos;

Por otra parte, su importancia dentro del mundo Big Data también se remite a la cantidad de comandos que existen, puesto que esta es inmensa y muy óptima en su desarrollo. En efecto, además de las queries simples de Hive que te hemos mostrado, podrás contar con otras como «modificar tablas», «jugar con joins», «funciones», etc.

Sigue aprendiendo más sobre Big Data

En el transcurso de este post, te has encontrado con todo lo relacionado a las queries simples de Hive y cómo se desarrollan dentro del mundo Big Data. Aun así, ten en cuenta que también es necesario aprender sobre las queries complejas, puesto que estas te permiten desarrollar más configuraciones. ¡Así que todavía queda mucho por aprender sobre Big Data!

Por este motivo, desde KeepCoding te ofrecemos el Bootcamp Full Stack Big Data, Inteligencia Artificial & Machine Learning. Gracias a este, te podrás familiarizar con los no desarrolladores de un ecosistema de desarrollo, aprenderás a conocer un IDE profesional y un lenguaje «nativo big data» de programación como Scala, con el cual se ha escrito uno de los motores de procesamiento más conocidos hasta la fecha, Apache Spark. En suma, podrás instruirte tanto de forma teórica como práctica en muchos más sistemas para el manejo Big Data ¡Apúntate ahora!