Como primer acercamiento a TensorFlow, la biblioteca principal dentro del Deep Learning, debes comprender que una red neuronal no es otra cosa que un optimizador de funciones. ¿Y para qué podrías utilizar este optimizador de funciones?

Pues bien, existen muchos problemas para los que es muy costoso solucionar de forma analítica, por lo que se emplean métodos numéricos que esta biblioteca de código abierto posee. De igual forma, si planeas iniciarte en esta plataforma, este post es ideal para ti.

A continuación, te compartimos cinco de los conceptos clave para comprender TensorFlow.

5 conceptos clave de TensorFlow

Deep Learning

El Deep Learning (DL), también como conocido en español como aprendizaje profundo, es un subcampo del Machine Learning al que, además, también se le llama aprendizaje jerárquico, debido a que aprende distintas representaciones de los datos que se introducen en un clasificador final.

A partir de allí, como data scientist ya no necesitas volverte loco buscando las mejores características o atributos para cada problema, sino que esto lo hace automáticamente el algoritmo trabajado en Deep Learning.

Por último, cabe destacar lo importante de tener una gran cantidad de datos para poder utilizar las técnicas de Machine Learning (ML) o Deep Learning (DL). Puesto que, cuanta más calidad tengan esos datos, mejor se comportaran nuestros modelos.

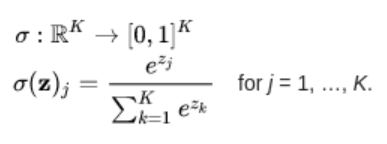

Función softmax

La función softmax en TensorFlow es una de las alternativas a la función de típico sigmoide de G = sigmoid().

Así, la fórmula de la función softmax en TensorFlow es la siguiente:

En definitiva, la función softmax en TensorFlow para el procesamiento de los datos implica:

- Poder convertir los datos procesados en probabilidades.

- Que la suma de las probabilidades arroje como resultado un 1.

Descenso de gradiente

El descenso del gradiente es de suma importancia, ya que es el mecanismo que hace que una red neuronal aprenda. En definitiva, puedes ver el descenso de gradiente como un algoritmo de optimización, por medio del que podrás minimizar cualquier función siempre que sea diferenciable, es decir, que puedas calcular sus derivadas.

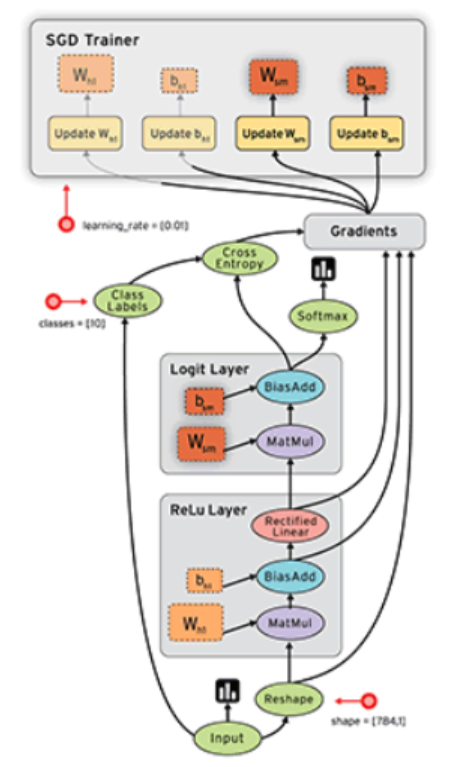

Sesiones iterativas y grafos

Para el uso de estas funciones, primero se definen las operaciones a realizar para que después se ejecuten.

Ahora, te compartimos un ejemplo de un grafo que representa la clasificación de una imagen de un número en su correspondiente clase:

Por último, en TensorFlow estas herramientas funcionan así: primero defines las operaciones que quieres que se realicen junto a las variables necesarias (creas el grafo) y, después, lo ejecutas (con una sesión).

tf.Operation

Para comprender a esta función debes contar con el conocimiento de tres conceptos básicos de TensorFlow que se relacionan con esta función:

- tf.Graph: representa un conjunto de tf.Operations.

- tf.Operation: son las operaciones indicadas por las ecuaciones que escribimos.

- tf.Tensor: los resultados de las tf.Operations.

Ahora, al hablar de una tf.Operation se mezclan las tres, a pesar de que esta función hace referencia a las operaciones que se inscriben en la consola.

Aprende más del Big Data

En este post, te hemos compartimos cinco de los conceptos clave dentro de la biblioteca de TensorFlow. Sin embargo, esta es solo una pequeña introducción, ¡aún queda mucho por conocer!

Por esta razón, desde KeepCoding te aconsejamos echarle un vistazo al Bootcamp Full Stack Big Data, Inteligencia Artificial & Machine Learning si lo que deseas es continuar aprendiendo y formarte como un data scientist profesional. Por medio de 11 módulos y de la mano de grandes expertos en el mundo del Big Data, podrás instruirte en los sistemas, lenguajes y programas más importantes para el manejo de los macrodatos. ¡No esperes más para inscribirte!