El clustering o agrupamiento en machine learning es una técnica de aprendizaje no supervisado en la que se da un algoritmo de agrupamiento de conjuntos de datos que presentan características similares.

Imagina que tienes un conjunto de libros o CDs que tienes que clasificar. Empiezas, pues, a clasificarlos por géneros musicales y literarios y vas desglosando hasta organizar tu biblioteca, de manera que cada una de las pertenencias tienen un lugar específico en el estante.

Así funciona el clustering o agrupamiento, ya que este consiste en agrupar ejemplares sin etiqueta que ahora tienen un lugar y pertenecen a algún grupo.

Ejemplo de clustering o agrupamiento

Tenemos los siguientes seres vivos:

- Vaca.

- Calamar.

- Perro.

- Sepia.

- Petunia.

- Ornitorrinco.

- Abeto.

- Naranjo.

Queremos clasificarlos en tres grupos basándonos en sus características. Una posible clasificación sería:

- Grupo 1: vaca, perro, ornitorrinco.

- Grupo 2: calamar, sepia.

- Grupo 3: abeto, naranjo, petunia.

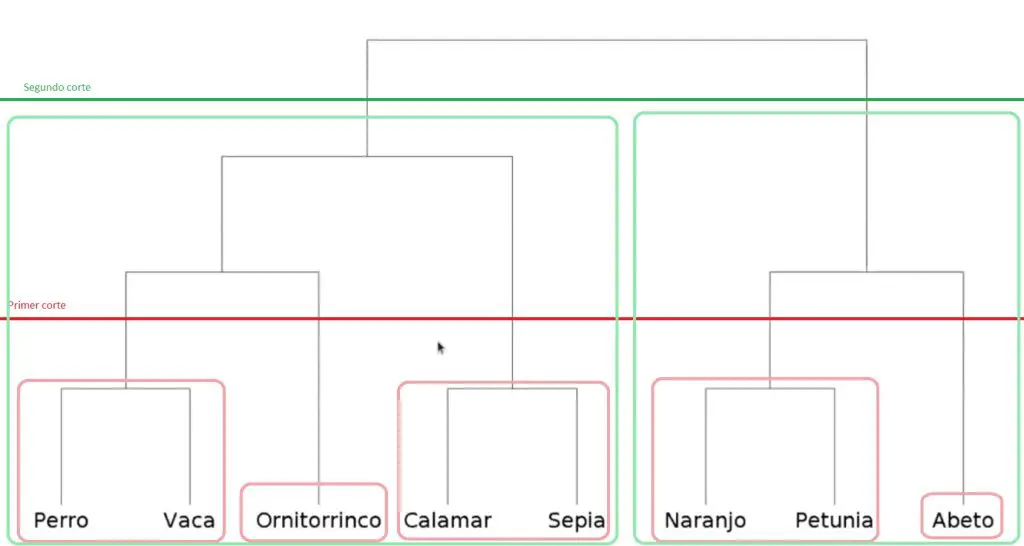

Podemos hacer un agrupamiento jerárquico basado en similitudes, de este modo damos a entender que perro y vaca se parecen mucho entre sí y que se parecen un poco más a un ornitorrinco. Ambos, perro y vaca, están separados del ornitorrinco por la categoría de animales placentarios y no placentarios.

También podríamos agrupar todos los animales entre vertebrados (perro, vaca, ornitorrinco) y no vertebrados (calamar, sepia).

En otra sección tendríamos las plantas.

Si nos fijamos en el primer corte, podríamos quedar con cinco grupos: perro – vaca, ornitorrinco, calamar – sepia, naranjo – petunia y abeto.

En el caso de que quisiéramos más similitudes, el clustering o agrupamiento se haría en el segundo corte, en donde solo tendríamos dos categorías: animales y plantas.

La distancia vertical marcaría cómo de separados están el número de grupos de cada familia.

Distancia en el clustering o agrupamiento

Lo primero que necesitamos calcular para hacer un ejercicio de clustering o agrupamiento es la distancia.

Antes de agrupar los elementos por su similitud, tenemos que definir la similitud misma. A un ordenador no le podemos decir, por ejemplo, que el clustering o agrupamiento lo haga por conjuntos de datos que sean mamíferos o que sean más verdes o más rojos; a este tenemos que darle información mucho más detallada y meticulosa.

Tipos de distancia

Existen diferentes tipos de distancia en el proceso del clustering o agrupamiento. Entre las más comunes están:

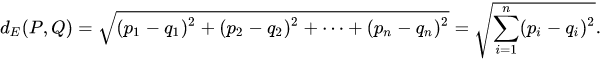

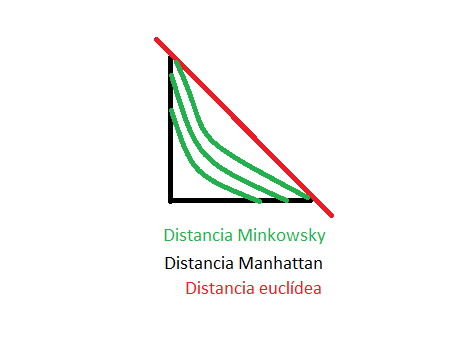

- La distancia euclídea: es la distancia que existe entre dos puntos de un plano. Se da en línea recta y se puede deducir a partir del teorema de Pitágoras.

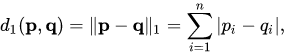

- La distancia Manhattan: es la distancia que se calcula por medio de la suma de la diferencia absoluta entre las medidas de todas las dimensiones de dos puntos. En otras palabras, es la distancia entre dos puntos, medida a lo largo de ejes en ángulo recto.

La distancia Manhattan también es llamada geometría del taxista y su primer nombre alude al diseño en cuadrícula que tienen la mayoría de las calles de la isla de Manhattan.

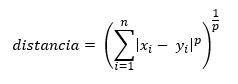

- La distancia Minkowsky: es la unión de la distancia euclídea y la distancia Manhattan, es decir, la distancia entre ambas. Si el valor es muy bajo o muy alto, la distancia Minkowsky tiende a una distancia Manhattan.

Existen muchos otros tipos de distancias, como la Chebyshev, la Jaccard, la Haversine la Sorensen-Dice o la distancia Cosine, entre otras. En todo caso, la distancia que más usaremos será la distancia euclídea.

Distancias con textos:

- Distancia Hamming: la distancia de Hamming entre dos cadenas de igual longitud es el número de posiciones en el cual los símbolos son diferentes.

- Distancia Levenshtein: la distancia Levenshtein entre dos palabras es el mínimo número de ediciones de un solo carácter (inserción, eliminación o sustitución) para que las dos palabras sean iguales.

¿Qué va a ocurrir? Pues que hay que hacer distintas coordenadas de nuestro sistema, distintas variables.

Como estas variables van a restarse unas con otras, tienen que ser comparables. No vale tener una en rangos de 1 millón, 2 millones y 10 millones, y otras en rangos de 1, 0.1, 0.5.

Entonces, antes de aplicar cualquier algoritmo de clasificación, ten en cuenta que hay que estandarizar o normalizar. Hay que hacer que las variables sean comparables entre sí; sino, no hay que hacer nada.

¿Qué sigue?

Ahora que hemos entendido qué es eso del clustering o agrupamiento, ¿qué te parece si damos el siguiente paso? Para ello te invitamos a seguir nuestro Big Data, Inteligencia Artificial & Machine Learning Full Stack Bootcamp, con el que podrás aprender, en tiempo récord, todos los conocimientos y técnicas necesarias para desempeñarte de manera óptima en el mundo laboral y obtener mejores oportunidades de empleo. ¡Anímate ya a solicitar más información!