IA en producción sin romper tu arquitectura. El 95% de los pilotos de IA generativa fracasa porque los equipos tratan la IA como software determinista cuando es un sistema probabilístico: sin observabilidad específica, sin versionado de prompts y sin arquitectura de fallback, el sistema se degrada sin aviso.

La mayoría de los equipos no fracasan por falta de modelos. Fracasan por mala integración. El 95% de los pilotos de IA generativa no entregan retorno medible, según el estudio del MIT NANDA sobre más de 300 iniciativas analizadas.

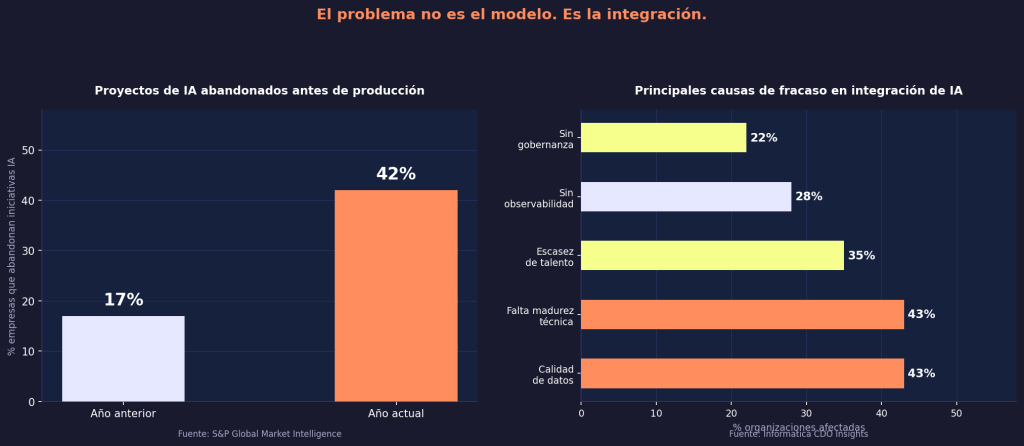

El 42% de las empresas abandonó la mayoría de sus iniciativas de IA antes de llegar a producción, cifra que se había más que duplicado respecto al período anterior, según S&P Global Market Intelligence. El 43% de las organizaciones identifica la calidad de datos y la falta de madurez técnica como el principal obstáculo. El 35% apunta a escasez de talento, según Informatica CDO Insights.

El modelo rara vez es el problema. La arquitectura alrededor de él es lo que falla bajo presión real: la tasa de fracaso de proyectos de IA duplica la de proyectos IT tradicionales, según la RAND Corporation. Integrar IA en producción significa incorporar modelos de lenguaje o sistemas inteligentes en arquitecturas reales de software de forma estable, evaluable y sostenible.

¿Por qué la IA en producción no funciona igual que en staging?

El problema de fondo es que la IA no es software determinista. En staging funciona porque el input está controlado y el equipo conoce el flujo. En producción el input real no es limpio, los usuarios no siguen el guion y los edge cases aparecen de formas que el equipo no anticipó.

Eso cambia las reglas de arquitectura de forma fundamental. Con software determinista, si el test pasa, el comportamiento está garantizado. Con un sistema probabilístico, pasar los tests en staging no garantiza nada sobre el comportamiento con inputs reales. La latencia en producción tampoco es la del piloto.

El coste por token real supera al estimado cuando el tráfico escala. Las respuestas impredecibles no son un edge case: son la norma cuando el input viene de usuarios reales con lenguaje natural no estructurado. El rol que toma estas decisiones es el del ingeniero de IA en producción: alguien que entiende el modelo y la infraestructura que lo sostiene y anticipa dónde falla cada parte.

¿Qué arquitectura necesita un sistema de IA para sostenerse en producción?

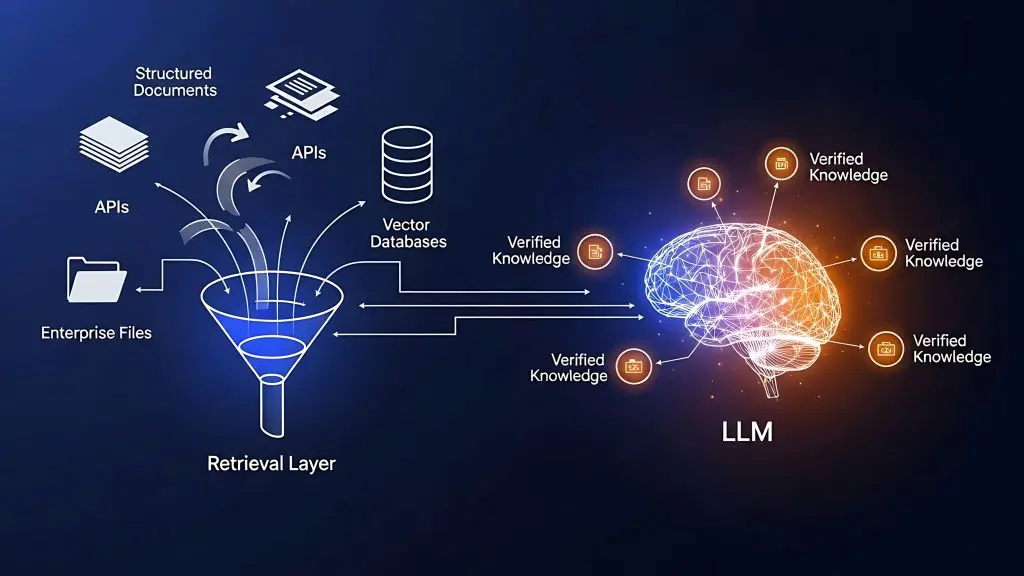

El primer elemento no negociable es la capa de abstracción para modelos. Esa capa desacopla el sistema del proveedor concreto y centraliza el control de prompts, versiones y configuración. Sin ella, cada cambio de modelo es una refactorización de emergencia.

El versionado explícito de prompts es lo que más equipos omiten y lo que más cuesta después. Un prompt es parte del código: debe tener historial de cambios, tests asociados y proceso de deploy con rollback posible. Hardcodear prompts en producción sin versionado es acumular deuda técnica con interés compuesto.

El diseño de timeout, retry y circuit breaker determina qué ocurre cuando el modelo falla o responde fuera del SLA. Sin estos mecanismos, un pico de latencia del proveedor se convierte directamente en interrupción del servicio visible para el usuario final.

En KeepCoding hemos comprobado que los equipos que no diseñan esta capa de abstracción desde el inicio hipotecan su arquitectura futura. La deuda no aparece en el piloto: aparece cuando el sistema escala o cuando el proveedor cambia un parámetro del modelo.

Los logs estructurados y el control de datos sensibles cierran los requisitos mínimos. Sin ellos, la auditoría es imposible y la responsabilidad ante un fallo en producción no tiene trazabilidad técnica sobre la que apoyarse.

¿Cómo medir si tu sistema de IA se está degradando?

La observabilidad específica para IA va mucho más allá de CPU, memoria y latencia. Sin indicadores propios del comportamiento del modelo, la degradación es silenciosa. Cuando el problema aparece, ya es reputacional y el tiempo de respuesta técnica llega tarde.

Los indicadores que no pueden faltar son: drift de comportamiento del modelo a lo largo del tiempo, tasa de alucinación en outputs, coherencia semántica entre input y respuesta, y coste por request real contra estimado. Ninguno de estos aparece en un dashboard de infraestructura convencional.

El versionado de prompts y el monitoreo de su comportamiento en producción son los dos elementos que más directamente determinan si el sistema que funcionó en el piloto es el mismo sistema tres meses después. La respuesta habitual es que no lo es, y la diferencia es invisible si no se mide.

¿Cuáles son las vulnerabilidades de seguridad específicas de los sistemas con LLMs?

La integración de LLMs amplía la superficie de ataque del sistema de formas que el equipo de seguridad tradicional no tiene en sus modelos de amenaza. El prompt injection, el data leakage y la exfiltración indirecta no son vulnerabilidades del modelo: son consecuencias de no diseñar el perímetro de seguridad con IA como componente del sistema.

La validación de input y sanitización de prompts debe tratarse con el mismo rigor que la validación de cualquier dato que entra al sistema. Un input diseñado para manipular el comportamiento del modelo puede extraer contexto de conversaciones ajenas o ejecutar instrucciones no autorizadas si el aislamiento no está diseñado.

El control de datos sensibles en el contexto enviado al modelo es el vector de riesgo más frecuente en integraciones empresariales. Los datos incluidos en el prompt para dar contexto necesitan el mismo tratamiento que los datos enviados a cualquier servicio externo: minimización, cifrado y auditoría de acceso.

La IA no es peligrosa por naturaleza. La improvisación en su integración sí lo es.

¿Cómo evaluar modelos de IA en producción cuando el input real no es predecible?

Un modelo puede tener F1 excelente en laboratorio y comportarse mal en producción. La razón es que el dataset de evaluación nunca cubre la distribución real del input de usuarios en producción. La evaluación en staging mide el modelo que el equipo diseñó, no el modelo que los usuarios reciben. La solución es evaluación continua con datasets que se actualizan con muestras del tráfico real.

El A/B testing entre versiones, las validaciones humanas en bucle para casos de baja confianza y las métricas alineadas a negocio son los elementos que convierten la evaluación en un proceso vivo. Sin evaluación continua, el sistema que funcionó en el piloto no es el mismo sistema en producción a los tres meses.

En KeepCoding hemos visto equipos que detectaban degradaciones de comportamiento solo cuando llegaban las primeras quejas de usuarios, porque no tenían instrumentación de evaluación desde el primer día.

¿Cuánto cuesta realmente integrar IA en producción y cómo controlarlo?

El coste real no es solo el precio por token. La latencia que afecta a la conversión, la infraestructura de observabilidad y el debugging de comportamientos impredecibles son partidas que no aparecen en el piloto.

La dependencia de proveedor externo, los reentrenamientos periódicos y los costes regulatorios se materializan al escalar.

Un piloto de bajo coste puede multiplicar por 20 su consumo anual sin arquitectura eficiente. El diseño económico es parte del diseño técnico desde el primer sprint. Quien lo trata como un problema de operaciones que se resolverá después, lo paga en producción.

Los siete errores más frecuentes de integración y sus consecuencias en producción se repiten con llamativa regularidad en equipos de todos los tamaños:

- Hardcodear prompts sin versionado: sin rollback posible si el comportamiento cambia.

- No separar entorno de experimentación y producción: contaminación de datos y fallos no reproducibles.

- No registrar contexto de conversación: pérdida de trazabilidad y auditoría imposible.

- No diseñar fallback ante fallo del modelo: interrupción del servicio sin alternativa técnica.

- No limitar consumo por usuario: costes desbocados ante picos de uso imprevistos.

- No anticipar cambios de modelo del proveedor: dependencia estructural sin capacidad de respuesta.

- Sin observabilidad específica para IA: degradación silenciosa sin señal de alerta.

Si quieres entender la magnitud del problema, el estudio del MIT NANDA analiza más de 300 iniciativas reales. La ejecución, y no la tecnología, es el factor diferencial en la integración de IA en producción.

Conclusión

Integrar IA en producción no fracasa por el modelo. Fracasa por la arquitectura alrededor. El 95% de los pilotos de IA generativa no entregan retorno medible porque los equipos tratan la IA como software determinista en lugar de diseñar para variabilidad. Los elementos no negociables son: capa de abstracción con versionado, observabilidad específica para comportamiento de modelo, seguridad ante prompt injection y evaluación continua alineada a métricas de negocio.

Si lo que has leído describe los retos reales de tu equipo, el Programa Técnico Avanzado en Ingeniería de IA de Keepcoding está diseñado exactamente para esto. Formación estructurada en IA aplicada a producción real, desde la arquitectura hasta el despliegue y la supervisión en producción.

En resumen

- La IA no es una API determinista: requiere arquitectura probabilística desde el primer sprint.

- Sin observabilidad específica, el sistema se degrada sin aviso y el problema aparece cuando ya es reputacional.

- El prompt es parte del código: debe versionarse, probarse y auditarse con el mismo rigor.

- La seguridad cambia: prompt injection y data leakage son vulnerabilidades nuevas que el equipo de seguridad tradicional no cubre por defecto.

- El coste real incluye latencia, debugging, dependencia de proveedor y regulación. El piloto no lo refleja.

- Evaluar en producción no es opcional. Es estructural. El modelo del piloto no es el mismo tres meses después si no se mide.

- El modelo rara vez falla. Falla la infraestructura invisible alrededor de él.

El coste de no diseñar bien desde el inicio no es técnico. Es estratégico. Un piloto exitoso que escala sin arquitectura puede multiplicar su coste por 20 en producción real. La razón por la que el criterio del ingeniero sigue siendo el factor diferencial es exactamente esta: la IA ejecuta, pero no decide cómo debe estar construido el sistema que la sostiene.

Artículos relacionados

IA para programadores: qué cambia en tu carrera