Una función de pérdidas en Deep Learning hace referencia a la forma de encontrar las equivocaciones cometidas en el procesamiento de los macrodatos en Deep Learning. En efecto, este proceso te ayudará a comprender cómo se comportan determinados procesos y conseguirá que los resultados arrojados y su respectiva esquematización sea mucho más efectiva.

Una vez te introduces en las redes neuronales profundas, estas te permiten encontrar automáticamente las características para abordar los problemas de data aprovechando la gran cantidad de datos disponibles.

Por esta razón, en el desarrollo de este post te explicamos qué es una función de pérdidas en Deep Learning, de manera que puedas comprender cómo emplear este tipo de funciones de perdida redes neuronales en el procesamiento de los macrodatos.

¿Qué es una función de pérdidas en Deep Learning?

La función de pérdidas en Deep Learning es la que nos indica cuánto nos hemos equivocado con nuestras predicciones.

Imagina que tenemos que adivinar cuánto cuesta una casa simplemente viendo una foto. Nuestra red tendría como entrada los píxeles de la foto y como salida un número indicando el precio.

Por ejemplo, digamos que queremos predecir el precio de esta casa:

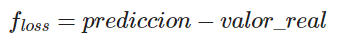

Imagina que estamos entrenando la red y que esta casa está dentro de nuestro conjunto de training. Cuando la imagen pasa hacia delante, se calcula una predicción, que es que vale 323.567€. La verdad es que la casa cuesta 600.000€, así que parece obvio que una funcion de perdida en Deep Learning adecuada podría ser:

Es exactamente lo mismo que con un SVM o la regresión lineal, por ejemplo.

Dentro de una función de pérdidas en Deep Learning, las más comunes son:

- Problemas de regresión:

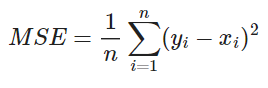

- Mean Squared Error

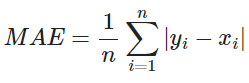

- Mean Absolute Error

- Problemas de clasificación:

- Binary Cross-Entropy

- Categorical Cross-Entropy

Veamos cómo se expresan cada una de ellas:

- Mean Squared Error:

- Mean Absolute Error:

Función Sigmoide

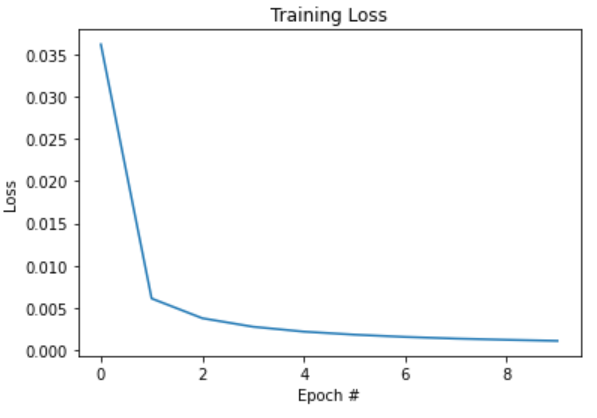

#Función de pérdidas en deep learning # probamos la sigmoid activation_function = tf.nn.sigmoid learning_rate = 0.1 lr_decay = 1e-3 n_epochs = 10 batch_size = 128 train_network_decay_fnact(activation_function, learning_rate, lr_decay, batch_size, n_epochs)

[0] cost: 0.03613612315637044 lr: 0.0999

[1] cost: 0.006143541028071844 lr: 0.0998001

[2] cost: 0.0038131086578015163 lr: 0.0997002999

[3] cost: 0.0028054684328375525 lr: 0.0996005996001

[4] cost: 0.0022318459328672133 lr: 0.0995009990004999

[5] cost: 0.001871975824249896 lr: 0.0994014980014994

[6] cost: 0.0016054004276907258 lr: 0.0993020965034979

[7] cost: 0.0014098625009258598 lr: 0.09920279440699441

[8] cost: 0.001265944427151736 lr: 0.09910359161258742

[9] cost: 0.001140994936339601 lr: 0.09900448802097483

¡Entrenamiento finalizado!

Accuracy: 0.6705

En este post, te hemos expuesto qué es y cómo se comporta una función de pérdidas en Deep Learning, de manera que ahora puedas comprender a qué se refiere y cuándo se utiliza. Sin embargo, este es un campo muy amplio y requiere de un estudio teórico y práctico más especializado.

Si no sabes dónde conseguirlo, debes echar un vistazo a nuestro Bootcamp Full Stack Big Data, Inteligencia Artificial & Machine Learning, ya que te permitirá consolidar tus conocimientos y poner a prueba tus destrezas en este ámbito de transformaciones y acciones en Spark. En el transcurso de esta formación intensiva, aprenderás a utilizar sus métodos de inteligencia artificial, aprendizaje automático, estadística y sistemas de bases de datos, entre muchas otras cosas. ¡No lo dudes más, matricúlate y empieza ahora!