LLMOps (Large Language Model Operations) es la disciplina que gestiona el ciclo de vida completo de un modelo de lenguaje en producción: despliegue, versionado de prompts, evaluación semántica de outputs, monitorización de comportamiento, control de costes y gobernanza del uso de datos.

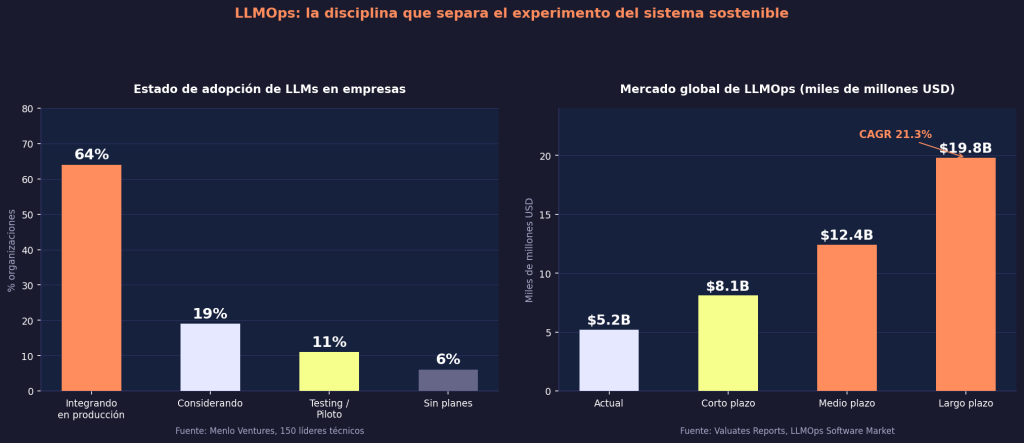

El 64% de las organizaciones ya integra y despliega LLMs en producción real, no en fase de piloto. El mercado de herramientas para operarlos supera los 5.000 millones de dólares y crece al 21% anual. Tras analizar 1.200 deployments reales, la conclusión de ZenML es unánime: la fase de experimentación ha terminado, la fase de ingeniería ha comenzado.

¿Qué es LLMOps y por qué no es lo mismo que MLOps?

MLOps gestiona el ciclo de vida de un modelo: entrenamiento, validación de datasets y despliegue. El objeto de trabajo es el modelo en sí. Sus pipelines están diseñados para detectar drift estadístico, reentrenar con nuevos datos y garantizar la reproducibilidad del entrenamiento.

LLMOps gestiona algo distinto: la interacción entre modelo, prompt, contexto y sistema. El modelo ya está entrenado y no se toca. Lo que cambia continuamente es el prompt, el contexto inyectado y la configuración de temperatura.

En MLOps se versiona el modelo. En LLMOps se versiona también el prompt y todo lo que rodea la llamada.

En KeepCoding hemos comprobado que los equipos que intentan aplicar MLOps directamente a LLMs terminan con sistemas que fallan de formas que sus pipelines no detectan. El drift que importa en LLMOps no es estadístico: es semántico. Y eso no aparece en ningún dashboard de MLOps convencional.

Las diferencias entre ambas disciplinas quedan así en cinco dimensiones clave:

- Foco principal: MLOps trabaja sobre el modelo y su entrenamiento. LLMOps trabaja sobre la interacción modelo, prompt y contexto.

- Qué se versiona: en MLOps, modelo, datasets y pipelines. En LLMOps, prompts, configuraciones y contexto inyectado.

- Tipo de evaluación: MLOps usa métricas estadísticas como F1 o AUC. LLMOps usa evaluación semántica y human-in-the-loop.

- Principal riesgo: drift estadístico del modelo en MLOps. Degradación de comportamiento sin señal en LLMOps.

- Gobernanza: MLOps gobierna datos de entrenamiento. LLMOps gobierna los datos enviados a APIs externas y los outputs generados.

La integración en producción de un sistema con LLMs es el contexto donde estas diferencias se vuelven críticas. El artículo sobre cómo integrar IA en producción sin romper tu arquitectura desarrolla qué elementos de diseño necesita ese sistema antes de que LLMOps tenga sentido aplicarlo.

¿Cómo versionar prompts y por qué es tan crítico como versionar código?

El prompt es parte del código. Un cambio de una sola palabra puede alterar radicalmente el comportamiento del sistema en producción. Sin versionado de prompts no hay ingeniería: hay improvisación con efectos que nadie puede rastrear ni deshacer.

Lo que se versiona en LLMOps no es solo el texto del prompt. Se versiona también la temperatura y top_p del modelo, el modelo concreto utilizado, el contexto inyectado y el autor del cambio.

Ese conjunto forma la unidad reproducible sobre la que se puede hacer rollback, auditoría y comparación de rendimiento entre versiones.

El error más frecuente es hardcodear prompts en el backend. El patrón que sigue es siempre el mismo: el equipo ajusta el string directamente en el código, despliega, y si algo empeora no tiene forma de saber si fue el prompt, el contexto, la temperatura o una combinación de los tres. El rollback se convierte en trabajo de arqueología.

La solución es tratar el prompt como cualquier otro componente crítico: repositorio propio, historial de cambios, tests asociados a cada versión y proceso de deploy con rollback explícito. La reproducibilidad y la auditoría no son características avanzadas de LLMOps. Son el requisito mínimo para que el equipo tenga control real sobre el sistema.

¿Cómo evaluar las respuestas de un LLM en producción cuando no hay respuesta correcta?

No se puede hacer un assert tradicional sobre una respuesta probabilística. Una respuesta puede ser técnicamente válida y semánticamente incorrecta para el contexto del usuario. El testing en LLMOps requiere un enfoque radicalmente distinto al testing de software determinista.

Las técnicas que funcionan en producción son: comparación con respuestas esperadas por rango de aceptabilidad, validación por embeddings para medir similitud semántica, y detección de patrones prohibidos en el output.

A eso se suma la clasificación automática de calidad con un modelo evaluador y el A/B testing entre versiones de prompt para medir cuál produce resultados más consistentes. El argumento diferenciador de LLMOps es que no busca determinismo. Busca control de variabilidad. El objetivo no es garantizar que el modelo siempre dé la misma respuesta, sino que las respuestas se mantengan dentro de rangos de calidad aceptables para el sistema.

No es lo mismo, y confundirlos lleva a métricas que no miden lo que importa. El perfil que diseña y mantiene estos sistemas de evaluación es quien entiende tanto el modelo como el sistema que lo usa. Eso es lo que describe el análisis sobre qué hace un ingeniero de IA en un equipo técnico con LLMs en producción.

¿Qué métricas de observabilidad son específicas de sistemas con LLMs?

Los dashboards de infraestructura miden CPU, memoria, latencia y errores HTTP. En un sistema con LLMs, esas métricas pueden ser perfectas mientras el sistema se está degradando activamente. La observabilidad en LLMOps necesita métricas propias del comportamiento del modelo.

Las métricas que no pueden faltar son: tasa de respuestas semánticamente erróneas, desviación semántica respecto al comportamiento esperado, coste por interacción real contra estimado, latencia por modelo y por tipo de llamada, frecuencia de fallback y tasa de alucinación en outputs críticos.

En KeepCoding hemos analizado casos de equipos que llevaban meses operando un LLM sin saber que su tasa de respuestas semánticamente incorrectas superaba el 15%. El sistema respondía, el uptime era del 99,9% y todas las alertas estaban en verde. La degradación era invisible para los sistemas de monitorización convencionales.

Lo que no se mide, degrada al sistema. Y en producción la degradación silenciosa es el peor tipo de fallo: cuando aparece en forma de queja de usuario o incidente de reputación, lleva semanas de histórico que analizar para entender cuándo empezó y por qué.

¿Cómo aplicar gobernanza en el uso de LLMs sin frenar al equipo de desarrollo?

La gobernanza en LLMOps no es burocracia. Es el conjunto de decisiones que evitan que el sistema se vuelva incontrolable cuando escala. Un equipo sin gobernanza puede operar un LLM en producción durante meses y no saber qué datos está enviando al proveedor, quién puede modificar prompts, ni qué ocurre con las conversaciones almacenadas.

Las preguntas que definen la gobernanza real son cuatro:

¿qué datos se envían al proveedor en cada llamada?

¿Se almacenan las conversaciones y quién tiene acceso?

¿Quién puede modificar prompts en producción y con qué proceso de validación?

¿Qué ocurre si el proveedor cambia su política de datos o depreca el modelo?

En el contexto europeo, el cumplimiento del GDPR añade una capa adicional: los datos de usuarios que viajan como contexto al proveedor externo tienen el mismo tratamiento que cualquier dato personal enviado a un servicio tercero. El aislamiento de entornos, el control de acceso a prompts y el registro de decisiones técnicas no son elementos opcionales: son el estándar mínimo de operación responsable.

Cuando el equipo no tiene la capacidad interna para establecer esa gobernanza, la decisión sobre quién la asume tiene consecuencias técnicas y legales. Esa tensión entre capacidad interna y soporte externo se desarrolla en detalle en el artículo sobre consultoría frente a capacidad interna en ingeniería de IA.

¿Quién debe liderar LLMOps en una organización y qué perfil necesita?

LLMOps no es responsabilidad del Data Scientist, que trabaja principalmente en experimentación y análisis. Tampoco es responsabilidad del DevOps clásico, que opera sistemas deterministas. Es responsabilidad del perfil que entiende el sistema completo: el AI Engineer.

Las habilidades que requiere este rol son: arquitectura de software para diseñar la capa de abstracción y el sistema de fallback, y fundamentos de LLMs para entender qué genera el comportamiento observado. A eso se añaden evaluación semántica para medir lo que importa, seguridad ante prompt injection y gobernanza de datos para operar con criterio regulatorio.

La razón por la que este perfil no puede ser sustituido por la propia IA se desarrolla en el artículo sobre el criterio que la IA no puede sustituir. Las decisiones sobre qué automatizar, qué supervisar y qué no delegar nunca al modelo requieren juicio humano con contexto real del sistema.

Conclusión

LLMOps es la disciplina que separa los equipos que experimentan con LLMs de los que los operan con criterio real. El 64% de las organizaciones ya tiene LLMs en producción, pero la mayoría sin las prácticas que evitan la degradación silenciosa.

Versionar prompts, evaluar semánticamente los outputs, monitorizar comportamiento más allá de la latencia y establecer gobernanza de datos no son opciones avanzadas. Son el estándar mínimo para que un sistema con LLMs sea sostenible en producción.

El mercado crece al 21% anual porque las organizaciones están aprendiendo que no basta con acceder al modelo. Hay que operarlo. Y eso requiere ingeniería, no solo herramientas.

Si lo que describes es el problema de tu equipo, la formación avanzada en ingeniería de IA para producción de Keepcoding cubre LLMOps aplicado a producción real. Versionado, evaluación, gobernanza y criterio técnico: los cuatro ejes del programa. Como hizo Marta, arquitecta técnica que implementó LLMOps en su equipo tras el programa y redujo su tasa de incidencias en producción en menos de dos meses.

Habla con un asesor de admisiones y diseña tu plan de especialización en IA aplicada a producción.

En resumen

- LLMOps no es MLOps: responde a los retos específicos de sistemas probabilísticos que MLOps no está diseñado para gestionar.

- El prompt es código: debe versionarse, probarse y auditarse como cualquier componente crítico del sistema.

- La evaluación semántica no tiene assert tradicional. El objetivo es controlar la variabilidad, no eliminarla.

- La observabilidad específica incluye tasa de alucinación, desviación semántica y coste por interacción. Los dashboards convencionales no la cubren.

- La gobernanza no frena al equipo. Define quién puede cambiar qué, con qué proceso, y protege al sistema frente a riesgos regulatorios.

- El AI Engineer es el perfil natural para liderar LLMOps en producción: entiende el modelo, el sistema y las decisiones que ninguno de los dos puede tomar solo.

Si quieres entender cómo los equipos más avanzados aplican LLMOps hoy, el análisis de ZenML sobre 1.200 deployments es el documento más útil sobre el estado real de LLMOps.