En mis primeros proyectos de inteligencia artificial con equipos de diferentes departamentos, noté algo preocupante: muchas personas empezaban a usar herramientas de IA sin avisar al área de tecnología o seguridad. Lo hacían con buenas intenciones, claro, buscando automatizar tareas o ser más eficientes. Pero esa práctica, aparentemente inocente, tiene nombre y consecuencias reales. Se llama Shadow AI.

Según el informe de Simplilearn sobre tendencias tecnológicas para 2025, el fenómeno de Shadow AI es una de las principales preocupaciones emergentes. A medida que las herramientas de IA se vuelven más accesibles, aumentan también los riesgos de uso descontrolado, fuera de políticas corporativas, con implicaciones serias para la ciberseguridad, la privacidad y el cumplimiento legal.

¿Qué es exactamente Shadow AI?

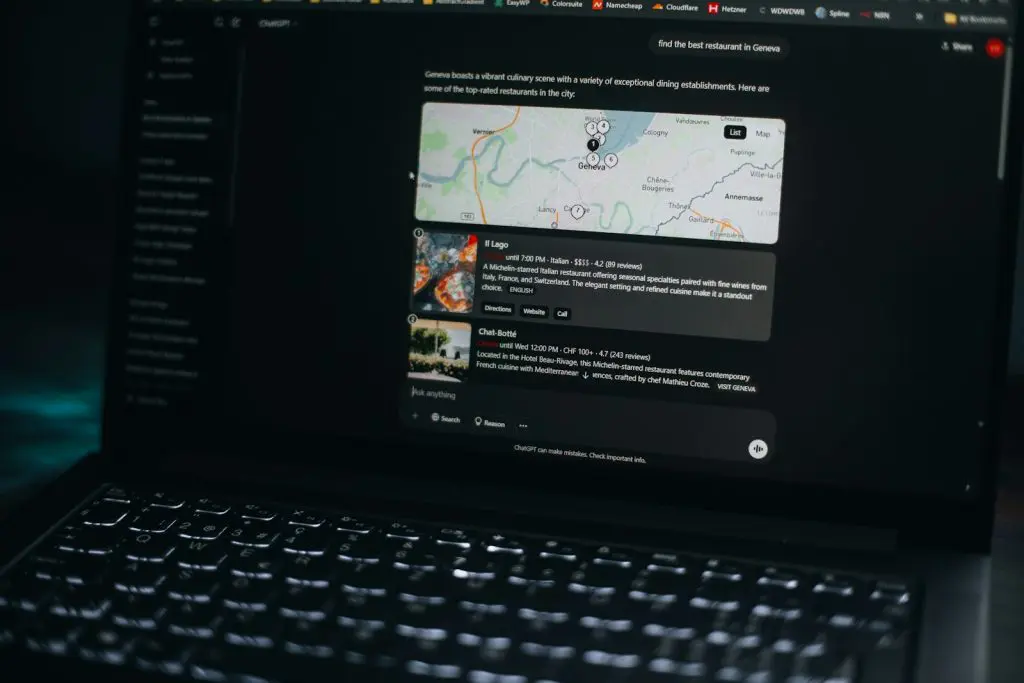

El término Shadow AI se refiere al uso no autorizado, no supervisado o no regulado de herramientas de inteligencia artificial dentro de una organización. Puede ser una hoja de cálculo conectada a una API de OpenAI, un script casero con Hugging Face, o el uso de plataformas como ChatGPT o Copilot para tareas profesionales… sin que el departamento de TI esté al tanto.

A diferencia de la “Shadow IT”, que se refiere al uso de tecnologías sin aprobación formal, Shadow AI añade el factor de automatización, tratamiento de datos y toma de decisiones algorítmica, lo que lo hace aún más crítico.

¿Por qué es un problema?

A simple vista, Shadow AI puede parecer inofensiva: un empleado usando una IA para resumir textos, generar código o analizar una tabla de datos. Pero los riesgos son importantes:

- Exposición de datos sensibles: al copiar información en plataformas externas sin control, se puede comprometer propiedad intelectual, datos de clientes o información regulada.

- Falta de trazabilidad y control: los modelos usados no están validados, auditados ni integrados en los flujos corporativos.

- Sesgos y errores sin supervisión: decisiones tomadas por IAs no alineadas con las políticas de la empresa pueden generar resultados discriminatorios, erróneos o ilegales.

- Riesgo reputacional y legal: en caso de fuga de información o decisión automatizada incorrecta, la organización puede enfrentarse a multas o pérdida de confianza.

En mi experiencia, muchas veces el Shadow AI surge por necesidad: los equipos buscan soluciones a problemas reales, pero lo hacen sin saber los riesgos que implica.

🔴 ¿Quieres formarte en Inteligencia Artificial a un nivel avanzado? 🔴

Descubre nuestro Inteligencia Artificial Full Stack Bootcamp. La formación más completa del mercado y con empleabilidad garantizada

👉 Prueba gratis el Bootcamp en Inteligencia Artificial por una semana¿Cómo detectar y gestionar Shadow AI en tu organización?

Una de las claves está en educar y habilitar en lugar de prohibir. Estas son algunas estrategias que recomiendo aplicar:

- Auditoría interna: identifica qué herramientas de IA se están usando sin control oficial.

- Política clara de uso de IA: redacta y comunica una guía interna que explique qué herramientas están permitidas, cómo usarlas y qué datos pueden procesar.

- Capacitación transversal: forma a los equipos para que entiendan tanto las ventajas como los riesgos de la IA.

- Plataformas centralizadas: ofrece soluciones internas validadas y seguras que eviten la necesidad de buscar opciones externas.

- Monitorización continua: aplica controles de seguridad, uso de APIs y tráfico de datos para detectar comportamientos sospechosos o no autorizados.

No se trata de apagar la innovación, sino de canalizarla con responsabilidad.

FAQs sobre Shadow AI

¿Shadow AI es siempre malintencionada?

No, la mayoría de veces es producto del entusiasmo y desconocimiento. Pero eso no elimina sus riesgos.

¿Todas las empresas están expuestas a Shadow AI?

Sí, especialmente aquellas con una cultura de innovación fuerte y sin protocolos claros de adopción tecnológica.

¿Qué diferencia hay entre Shadow AI y Shadow IT?

La Shadow IT implica tecnología no aprobada; Shadow AI va más allá, incluyendo algoritmos, tratamiento de datos y decisiones automatizadas.

¿Cómo puede evitarse?

Con políticas claras, herramientas corporativas accesibles, auditorías y formación activa de los equipos.

Aprende a liderar proyectos de IA con responsabilidad

El fenómeno de Shadow AI es solo uno de los muchos retos que surgen al integrar inteligencia artificial en el entorno empresarial. Si quieres dominar esta tecnología y liderar su adopción de forma ética y estratégica, el Bootcamp de Inteligencia Artificial de KeepCoding te prepara para desarrollar modelos, gestionar riesgos y construir soluciones reales desde el primer día. KeepLearning, KeepCoding.