Aprender Data Engineering es aprender a construir sistemas de datos fiables: ingestión, transformación, modelado, calidad y entrega para analítica e inteligencia artificial.

Un buen roadmap para aprender Data Engineering combina fundamentos de programación y bases de datos con proyectos reales de pipelines y modelos de datos que puedas enseñar en entrevistas. El World Economic Forum sitúa los perfiles relacionados con IA y big data entre los puestos que más crecen en los próximos años, lo que explica por qué Data Engineering se ha vuelto una puerta de entrada muy sólida al mundo de datos.

Qué es Data Engineering y por qué es una carrera con tanta demanda

Data Engineering es la disciplina que diseña, construye y mantiene la infraestructura y los flujos de datos para que una empresa pueda analizar, entrenar modelos y tomar decisiones. Si lo quieres simplificar, el data engineer se encarga de que el dato llegue bien, a tiempo y con calidad a donde hace falta. En mi experiencia, la mayoría de equipos no fracasan por falta de ideas. Fracasan por falta de datos confiables. Sin un pipeline estable, el dashboard miente, el modelo se degrada y el negocio toma decisiones sobre ruido.

Qué hace un Data Engineer en el día a día

- Ingesta: traer datos desde APIs, bases de datos, logs, herramientas de marketing, producto o CRM.

- Transformación: limpiar, normalizar, enriquecer y estandarizar datos para que sean analizables.

- Modelado: diseñar tablas y capas de datos para analítica y reporting con métricas coherentes.

- Orquestación: programar, monitorizar y controlar ejecuciones para que los pipelines no fallen.

- Calidad y observabilidad: tests de datos, validaciones y alertas para detectar errores temprano.

- Performance y coste: optimizar consultas, almacenamiento y ejecución para escalar sin quemar presupuesto.

Si vienes desde cero y te falta base de programación, lo más rápido no es ir directo a Spark. Lo más seguro es construir primero fundamentos. Por eso, si tu punto de partida es principiante, un buen primer paso es el bootcamp para aprender a programar desde cero, y luego avanzar a datos con más control.

Perfiles cercanos y cómo se diferencia Data Engineering

Una confusión habitual es creer que todo lo de datos es lo mismo. No lo es. Data Engineering se centra en sistemas y fiabilidad, mientras otros perfiles se centran en análisis o modelos. Entender esta diferencia te ayuda a elegir bien el roadmap y a construir el portfolio correcto.

| Perfil | Foco principal | Producto final | Qué valoran en entrevistas |

|---|---|---|---|

| Data Analyst | Análisis y reporting | Dashboards, insights, métricas | SQL, storytelling, definición de KPIs |

| Data Engineer | Sistemas y pipelines | Datasets fiables, modelos de datos, orquestación | SQL avanzado, arquitectura, calidad, automatización |

| Data Scientist | Modelado y experimentación | Modelos, validación, análisis estadístico | Estadística, evaluación, experimentos |

| Machine Learning Engineer | Producción de modelos | Pipelines ML, APIs, monitorización | Ingeniería, MLOps, despliegue |

Si tu interés está más cerca de modelos y producción de IA, te puede ayudar entender conceptos como MLOps, porque muchas buenas prácticas de datos y operación se parecen.

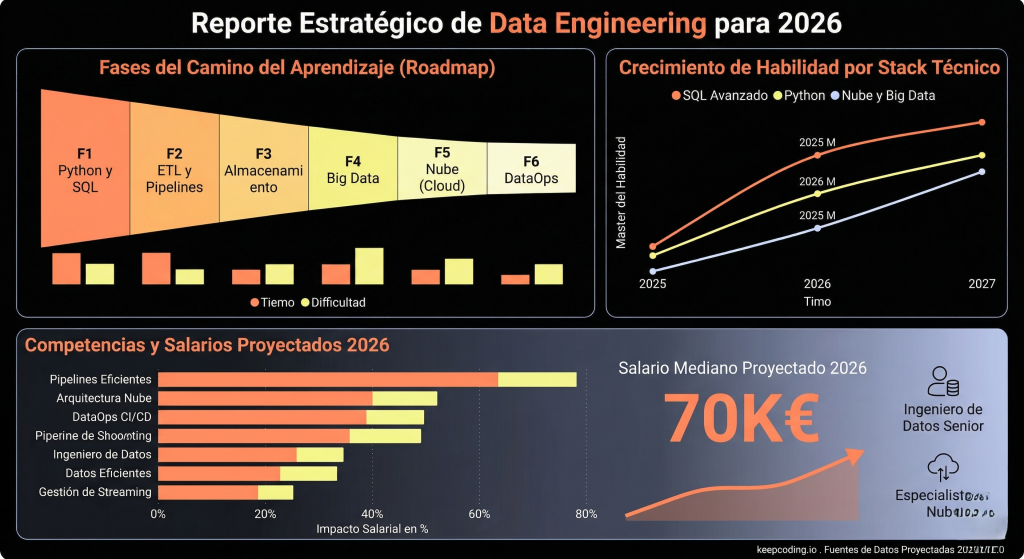

Roadmap para aprender Data Engineering por fases

Este roadmap está pensado para que avances sin dispersarte. Cada fase te deja una habilidad utilizable y un mini proyecto que puedes incluir en tu portfolio. Si haces las fases con proyectos, no dependes de certificados para demostrar valor.

Fase 0: mentalidad de ingeniería y hábitos de trabajo

Data Engineering no es solo aprender herramientas. Es aprender a trabajar como ingeniero: reproducible, medible y con control. Si solo haces notebooks sueltos, luego te costará pasar a pipelines reales.

- Git: versiona proyectos y documenta decisiones.

- Entornos: usa entornos virtuales y dependencias controladas.

- Debug: aprende a leer errores y a rastrear fallos.

- Documentación: README claros, supuestos, decisiones y limitaciones.

Mini proyecto: crea un repositorio con estructura estándar, un README y una carpeta de datos de ejemplo. Incluye una guía breve de cómo ejecutar el proyecto.

Fase 1: SQL serio, no solo SELECT

SQL es el idioma principal del Data Engineering. Si lo dominas, subes mucho. Si lo flojeas, te quedas limitado. En entrevistas, SQL suele ser filtro.

- Consultas: joins, subqueries, CTEs, window functions.

- Modelado: claves, normalización, desnormalización con criterio.

- Performance: índices, particiones, explain plans a nivel básico.

- Calidad: constraints, checks y consistencia de métricas.

Mini proyecto: crea una base de datos con 3 a 5 tablas, carga datos y construye un conjunto de consultas que respondan a métricas de negocio. Documenta definiciones para que no haya doble interpretación.

Fase 2: Python para pipelines y automatización

No necesitas ser un desarrollador senior, pero sí debes automatizar ingestas, validaciones y transformaciones. Python es muy útil para esto. Si ya estás trabajando el roadmap de Python, aquí lo conectas con datos.

- Lectura y escritura: CSV, JSON, Parquet.

- APIs: requests, paginación, rate limits, reintentos.

- ETL básico: extracción, transformación, carga con control de errores.

- Logging: registros útiles para depurar en producción.

Mini proyecto: ingesta desde una API pública, normaliza campos, guarda en una base de datos y genera un dataset final. Incluye logs y manejo de fallos para reintentar sin duplicar datos.

Fase 3: modelado de datos para analítica

Esta fase es donde un data engineer se vuelve realmente valioso. No basta con mover datos. Hay que diseñar un modelo que sirva para analítica y que sea coherente con el negocio. Aquí aparecen conceptos como capas, dimensiones, hechos y métricas consistentes.

- Capas: raw, staging, core, marts.

- Modelos: estrella, copo de nieve, wide tables con criterio.

- Métricas: definiciones únicas, no duplicadas por equipo.

- Incrementales: cargas por fecha, idempotencia y control de duplicados.

Mini proyecto: construye un modelo de datos de ecommerce o producto con capas. Define una tabla de hechos y varias dimensiones, y crea 8 a 12 métricas con definiciones claras.

Fase 4: orquestación y scheduling

En el mundo real, los pipelines se rompen. La orquestación es la diferencia entre un script suelto y un sistema confiable. Aquí aprendes a programar tareas, definir dependencias y gestionar fallos.

- Dependencias: qué corre antes y qué depende de qué.

- Retries: reintentos con backoff y reglas claras.

- Alertas: cuándo y a quién notificar si algo falla.

- Backfills: recalcular periodos sin romper consistencia.

Mini proyecto: convierte tu pipeline anterior en un flujo orquestado, con tareas separadas por etapas y alertas cuando hay fallos de calidad.

Fase 5: batch vs streaming, cuándo usar cada uno

Muchos empiezan pensando que streaming es mejor. No siempre. La elección depende de la latencia que necesites y del coste que puedas asumir. Para un junior, lo importante es entender el trade off y demostrar criterio.

| Enfoque | Cómo funciona | Ventaja | Limitación | Mejor para |

|---|---|---|---|---|

| Batch | Procesa datos por ventanas, por ejemplo cada hora o cada día | Simplicidad y coste controlado | Latencia mayor | Reporting, BI, modelos de datos |

| Streaming | Procesa eventos en tiempo cercano a real | Latencia baja | Complejidad operativa | Alertas, fraude, producto en tiempo real |

Mini proyecto: crea un pipeline batch sólido primero. Si quieres ir un paso más allá, añade una versión streaming simple que procese eventos y escriba resultados en una tabla de agregados.

Fase 6: calidad, tests y observabilidad de datos

Esta es la fase que más distingue a un data engineer serio. Una empresa puede tolerar un dashboard imperfecto. Pero no puede tolerar decisiones basadas en datos rotos. Aquí construyes confianza.

- Tests: valores nulos, rangos, unicidad, claves, referencialidad.

- Freshness: saber si los datos están actualizados.

- Lineage: entender de dónde sale cada métrica.

- Observabilidad: alertas cuando hay cambios anómalos en volumen o distribución.

Mini proyecto: añade un conjunto de tests a tu pipeline y crea un reporte de calidad que se genere cada ejecución. Incluye qué pasa cuando un test falla y cómo se gestiona.

Fase 7: cloud y herramientas modernas del stack

No necesitas dominar todos los proveedores. Lo importante es entender el concepto: almacenamiento, cómputo, permisos, costes y seguridad. En entrevistas suele bastar con explicar bien tu proyecto y cómo lo desplegarías.

- Almacenamiento: data lake, data warehouse, lakehouse.

- Permisos: roles, acceso mínimo, secretos.

- Coste: particiones, formatos, optimización de queries.

- Automatización: infraestructura como código a nivel básico.

Mini proyecto: despliega tu pipeline en un entorno cloud o simula una arquitectura cloud en local con contenedores. Documenta qué decisiones tomarías para seguridad y coste.

Herramientas y tecnologías que deberías aprender en orden

Para no dispersarte, aprende herramientas por capas. La idea es que cada capa apoye la siguiente. Si intentas dominar todo a la vez, te frustras.

| Categoría | Herramientas principales | Para qué se usan | Prioridad |

|---|---|---|---|

| Lenguajes | SQL, Python | Consultas, pipelines, automatización | Alta |

| Modelado | Capas, hechos y dimensiones | Métricas coherentes para analítica | Alta |

| Orquestación | Scheduling y dependencias | Operación y fiabilidad | Alta |

| Procesamiento | Batch y streaming | Transformaciones y pipelines | Media |

| Calidad | Tests, freshness, observabilidad | Confianza y detección de errores | Alta |

| Cloud | Servicios de storage y compute | Escalado, seguridad y coste | Media |

Un consejo práctico: si puedes explicar con claridad tu pipeline, tu modelo de datos y tus tests, la herramienta concreta pesa menos. En entrevistas, la claridad y el criterio suelen ganar.

Proyectos de portfolio para Data Engineering

Tu portfolio es tu mejor argumento. No necesita ser enorme. Necesita ser claro, reproducible y útil. En mi experiencia, tres proyectos bien documentados pueden abrir más puertas que diez cursos sin outputs.

Proyecto 1: pipeline de ingesta y limpieza

- Entrada: API pública o dataset con actualizaciones periódicas.

- Salida: base de datos con esquema claro.

- Extras: logs, reintentos, control de duplicados.

Proyecto 2: modelo analítico con métricas

- Capas: raw, staging, marts.

- Modelo: hechos y dimensiones con definiciones.

- Resultado: 10 métricas con significado de negocio.

Proyecto 3: calidad y observabilidad

- Tests: nulos, rangos, unicidad, claves.

- Freshness: alertas si no llega dato.

- Anomalías: alertas por cambios bruscos de volumen.

Si quieres añadir una pieza extra que te diferencie, conecta tu dataset con un caso de IA sencillo. Esto ayuda a demostrar impacto real. Para entender cómo se conectan datos y modelos en producción, te puede servir leer qué hace un ingeniero de machine learning.

Cómo conseguir tu primer trabajo en Data Engineering

Conseguir tu primer empleo suele depender de dos cosas: demostrar base y demostrar proceso. A una empresa le preocupa el riesgo. Tu trabajo es reducirlo con evidencia.

Qué revisan en un junior

- SQL: capacidad real de resolver problemas con joins y ventanas.

- Pipeline: si sabes construir algo reproducible y mantenible.

- Calidad: si piensas en tests y consistencia, no solo en que funcione una vez.

- Comunicación: si puedes explicar decisiones y trade offs con claridad.

Cómo presentarte en entrevistas

- Cuenta un proyecto de principio a fin con decisiones, errores y mejoras.

- Explica tu modelo: por qué esa tabla, por qué esa métrica, qué asumes.

- Muestra control: logs, tests, reintentos, idempotencia.

Si vienes de un cambio de carrera, tu narrativa importa. Te ayuda estructurar tu historia y tu plan de aprendizaje. Puedes apoyarte en cómo cambiar de carrera para ordenar ese mensaje.

Formación y ruta recomendada según tu punto de partida

No todo el mundo empieza igual. Esta sección te ayuda a elegir un camino realista sin saltarte fases clave.

Si empiezas desde cero

- Primero fundamentos de programación y lógica.

- Después SQL y datos con proyectos.

- Luego pipelines, orquestación y calidad.

Si ya programas pero nunca has trabajado con datos

- Entra fuerte en SQL, modelado y calidad.

- Construye dos proyectos completos con documentación.

- Añade cloud y orquestación al final.

Si ya estás en analítica y quieres pasar a ingeniería

- Refuerza arquitectura y operación de pipelines.

- Enfócate en orquestación, performance y costes.

- Construye modelos de datos consistentes para el negocio.

Conclusión

Data Engineering es una carrera muy práctica: tu valor se demuestra con sistemas de datos que funcionan, no con definiciones. Si sigues un roadmap por fases, dominas SQL, construyes pipelines y añades calidad y observabilidad, ya estás en la ruta correcta para entrar en el mercado.

- Empieza por SQL y Python con proyectos reproducibles.

- Aprende modelado de datos y métricas coherentes.

- Añade orquestación, tests y observabilidad para ganar fiabilidad.

- Construye un portfolio de 3 proyectos con README y decisiones claras.

- En entrevistas, explica proceso, trade offs y control de calidad.

Otros artículos que te pueden interesar

- Qué es MLOps

- Roadmap para ser Machine Learning Engineer

- Roadmap para ser AI Engineer

- Ingeniero de IA

- Funciones de un ingeniero de Machine Learning

- Cómo cambiar de carrera

Te recomiendo la siguiente lectura. IBM ¿Qué es la ingeniería de datos?