Aprender qué tecnologías aprender para trabajar en IA es construir una base técnica que te permita entrenar, evaluar y desplegar sistemas de inteligencia artificial con resultados medibles.

El orden importa más que la lista: primero fundamentos y datos, después modelos, y al final producción, evaluación y seguridad para que tu trabajo funcione en el mundo real.

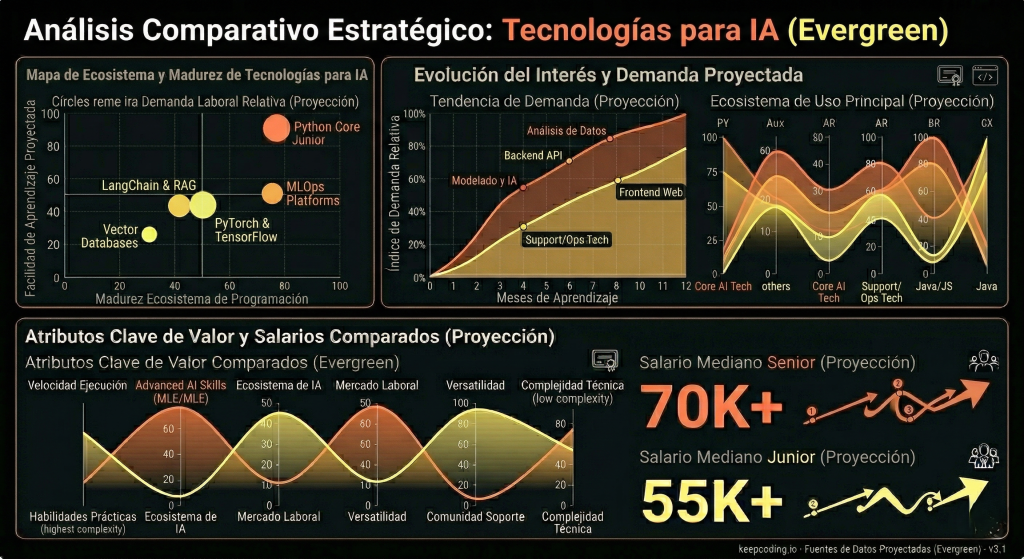

Dato de contexto: según el resumen del Future of Jobs Report del año anterior, el mercado vive una etapa de transformación acelerada por tecnología, con una presión fuerte en upskilling y nuevas habilidades durante los próximos años, lo que hace clave elegir un stack que se pueda actualizar sin rehacer tu carrera cada seis meses.

El mapa general de IA

En 2026, trabajar en IA ya no significa solo entrenar modelos. Significa entregar sistemas que funcionen con datos reales, con evaluación continua, con trazabilidad y con un mínimo de control de riesgos. Por eso las tecnologías que más valor aportan se agrupan en cinco bloques.

- Fundamentos de programación: para construir, depurar y mantener.

- Datos y analítica: para que el modelo tenga materia prima de calidad.

- Machine learning y deep learning: para resolver problemas predictivos y de percepción.

- IA generativa y LLMs: para casos de texto, búsqueda, asistentes y automatización.

- Producción y operación: para desplegar, medir, mejorar y asegurar.

Si tu objetivo es empleabilidad, la clave es demostrar que sabes conectar estos bloques con proyectos end to end, no que te sabes el nombre de cien herramientas.

Primero define tu destino: en IA hay varios trabajos distintos

La pregunta qué tecnologías aprender para trabajar en IA cambia según el rol. Elegir tecnologías sin definir el rol te lleva a estudiar de forma dispersa y a no poder explicar tu perfil en entrevistas.

🔴 ¿Quieres formarte en Inteligencia Artificial a un nivel avanzado? 🔴

Descubre nuestro Inteligencia Artificial Full Stack Bootcamp. La formación más completa del mercado y con empleabilidad garantizada

👉 Prueba gratis el Bootcamp en Inteligencia Artificial por una semanaRoles típicos y qué construyen

- Data Analyst: métricas, reporting, análisis exploratorio y automatización ligera.

- Data Engineer: pipelines, modelos de datos, calidad, orquestación y costes.

- Data Scientist: experimentos, modelos, evaluación y comunicación de resultados.

- Machine Learning Engineer: modelos en producción, APIs, monitorización, MLOps.

- AI Engineer: aplicaciones con LLMs, RAG, agentes, evaluación y guardrails.

En mi experiencia, el salto de junior a un perfil competitivo ocurre cuando pasas de aprender modelos a entregar un sistema completo, aunque sea pequeño: datos, modelo, evaluación, despliegue y documentación.

Cuadro comparativo: qué tecnologías priorizar según el rol

Este cuadro es una brújula rápida. No pretende cubrirlo todo, pretende evitar que empieces por el final.

| Rol objetivo | Tecnologías imprescindibles | Tecnologías diferenciales | Qué debes demostrar |

|---|---|---|---|

| Data Analyst | SQL, Python básico, visualización | Automatización, calidad de datos | Métricas coherentes y análisis accionable |

| Data Engineer | SQL avanzado, Python, modelado | Orquestación, observabilidad, cloud | Pipelines reproducibles y fiables |

| Data Scientist | Python, estadística, scikit-learn | Experimentación, interpretabilidad | Modelos evaluados con criterio y explicación clara |

| Machine Learning Engineer | Python, datos, despliegue, MLOps | Monitorización, escalabilidad, costes | Modelos operables en producción |

| AI Engineer | Python, APIs, LLMs, RAG, evaluación | Seguridad, guardrails, observabilidad | Apps con LLMs que funcionan con calidad y control |

Bloque 1: programación y base técnica que no se negocia

Si te preguntas qué tecnologías aprender para trabajar en IA, la primera respuesta es menos glamourosa: aprender a programar bien. En 2026, la diferencia no está solo en saber usar un modelo, sino en poder construir y mantener software alrededor del modelo.

Python como lenguaje base

Python sigue siendo la puerta principal para IA por su ecosistema. Lo importante es dominarlo como programador, no como usuario de notebooks. Eso implica escribir código limpio, manejar errores y organizar proyectos.

- Fundamentos: tipos, estructuras, funciones, módulos, errores.

- Trabajo con archivos: CSV, JSON y formatos de datos.

- Buenas prácticas: estructura de proyecto, entornos, dependencias, Git.

Si empiezas desde cero absoluto, te conviene construir fundamentos de programación antes de meterte en modelos. Para esa base, el paso más directo es el Bootcamp Aprende a Programar desde Cero, porque te da lógica, hábito y práctica que luego vas a usar en IA.

Git y hábitos de ingeniería

Git no es opcional si quieres trabajar en equipos. También es una señal fuerte en entrevistas: repositorios limpios y commits consistentes cuentan una historia de trabajo real.

- Repositorios: estructura clara y README útil.

- Ramas: cambios pequeños, revisables.

- Documentación: decisiones y límites, no solo resultados.

Bloque 2: datos, SQL y calidad, el corazón de cualquier sistema de IA

En el mundo real, el modelo no falla primero. Lo que falla primero es el dato: llega tarde, llega roto, cambia de formato, o está sesgado. Por eso, dominar datos es lo que te convierte en alguien útil para un equipo, incluso antes de ser experto en deep learning.

SQL como superpoder práctico

SQL aparece en casi cualquier rol de datos e IA. En 2026, el diferencial es SQL de verdad, no solo consultas básicas.

- Joins y CTEs: para combinar fuentes y mantener claridad.

- Window functions: para cohortes, rankings, métricas temporales.

- Calidad: duplicados, nulos, claves y consistencia.

Modelado de datos y capas

Si no entiendes modelado, acabarás con métricas inconsistentes y pipelines frágiles. Aprender capas de datos te ayuda a construir sistemas mantenibles.

- Capas: raw, staging, core, marts.

- Hechos y dimensiones: para analítica coherente.

- Definición de métricas: una fuente de verdad, no interpretaciones.

Si quieres profundizar en esta parte con un roadmap completo, puedes revisar Roadmap para aprender Data Engineering, porque es la base que más acelera proyectos de IA cuando los datos se vuelven complejos.

Bloque 3: machine learning clásico, lo que más se usa y mejor paga cuando se hace bien

Machine learning clásico sigue siendo altamente útil en 2026. Muchos casos de negocio se resuelven con modelos robustos y bien evaluados, sin necesidad de redes enormes. La clave es el proceso: datos, baseline, validación, análisis de errores, iteración.

Librerías y prácticas esenciales

- Pandas y Numpy: para preparar datos y trabajar con arrays.

- scikit-learn: para modelos base, pipelines y evaluación.

- Métricas: accuracy, precision, recall, AUC, RMSE según el problema.

- Validación: separación train test, cross validation, overfitting.

Cuadro comparativo: tipos de problemas y modelos habituales

| Problema | Qué predices | Modelos típicos | Métrica útil |

|---|---|---|---|

| Clasificación | Una categoría | Logística, árboles, random forest | Precision y recall |

| Regresión | Un valor numérico | Lineal, gradient boosting | RMSE o MAE |

| Clustering | Grupos sin etiquetas | K-means, DBSCAN | Validación cualitativa y métricas internas |

| Recomendación | Qué mostrar a quién | Filtrado colaborativo, ranking | CTR y métricas offline |

Si te interesa entender cómo se conectan estos modelos con el rol y el mercado, te puede ayudar leer Data Scientist vs Machine Learning Engineer para ubicar qué parte del stack te gusta más.

Bloque 4: deep learning y redes neuronales cuando realmente aportan ventaja

Deep learning no es obligatorio para todo, pero sí es crítico si trabajas con texto, visión, voz o embeddings. En 2026, el foco práctico está en saber usar deep learning con criterio y evaluación, no en inventar arquitecturas.

Tecnologías clave

- PyTorch o TensorFlow: elige uno y domínalo antes de saltar.

- Embeddings: base de búsqueda semántica y RAG.

- Fine-tuning: cuándo tiene sentido y cuándo no.

- Evaluación: análisis de errores por casos, no solo una métrica global.

Qué proyectos demuestran deep learning de verdad

- Clasificación de texto: con dataset real y análisis de falsos positivos.

- Visión: detección o clasificación con control de drift y calidad.

- Embeddings: clustering y búsqueda con validación humana.

Bloque 5: IA generativa, LLMs y el salto a sistemas con calidad y control

En 2026, la IA generativa se vuelve más valiosa cuando se integra con datos propios, con evaluación y con límites claros. El mercado empieza a premiar menos el prototipo y más el sistema que se puede operar con confianza.

Tecnologías que deberías dominar

- RAG: indexación, chunking, recuperación y trazabilidad interna.

- Evaluación: tests, casos límite, métricas de calidad de respuesta.

- Orquestación: flujos de herramientas y pasos, no solo un prompt suelto.

- Guardrails: validación de entradas y salidas, límites, políticas.

Cuadro comparativo: prototipo vs sistema listo para negocio

| Elemento | Prototipo típico | Sistema serio | Qué mide |

|---|---|---|---|

| Fuente de verdad | Responde de memoria | RAG con documentos y trazabilidad | Consistencia y control |

| Calidad | Se prueba a ojo | Suite de evaluación con casos | Fiabilidad |

| Seguridad | Sin filtros | Guardrails y permisos por acción | Riesgo |

| Operación | Sin logs | Observabilidad, logs y alertas | Mantenimiento |

Si te interesa este enfoque de aplicaciones con modelos y sistemas, puedes reforzarlo con Roadmap para ser AI Engineer, que aterriza qué se pide cuando la IA se convierte en producto.

Bloque 6: MLOps y LLMOps, la parte que sube tu valor en entrevistas

En 2026, MLOps y LLMOps se vuelven un diferenciador claro. No necesitas ser experto en infraestructura desde el día uno, pero sí debes entender el ciclo de vida: versionado, despliegue, monitorización y mejora.

Tecnologías y prácticas a priorizar

- Experiment tracking: registrar métricas, datasets y configuraciones.

- Versionado: datos, modelos y parámetros.

- Despliegue: batch, API o streaming según caso.

- Monitorización: drift, latencia, coste y calidad.

- Calidad: tests de datos y validaciones de salida.

Para aterrizar conceptos y entender por qué esto importa, te puede servir Qué es MLOps, porque explica la lógica de producción que el mercado valora cuando un modelo ya no vive en un notebook.

Bloque 7: seguridad y riesgos, lo que evita que tu proyecto se convierta en un problema

La IA en producción trae riesgos. En 2026, saber mitigarlos es parte del trabajo. Incluso si tu rol es de desarrollo o marketing técnico, entender seguridad básica te hace más valioso porque reduces errores de diseño.

Riesgos prácticos que deberías contemplar

- Datos sensibles: control de acceso, anonimización, mínimos necesarios.

- Prompt injection: entradas maliciosas que cambian el comportamiento.

- Fugas: información revelada por mala configuración o por contexto.

- Coste y abuso: modelos expuestos sin límites ni rate limiting.

Si te interesa ampliar hacia seguridad como carrera o como complemento serio, puedes revisar Cómo empezar una carrera en ciberseguridad para entender bases que se cruzan con IA en producción.

Roadmap de 12 semanas con tecnologías concretas para empezar en IA

Este plan es realista si dedicas entre 6 y 10 horas por semana. Si dedicas menos, estira el calendario. Lo importante es terminar con proyectos completos y documentados.

Semanas 1 a 3: base de programación y datos

- Python base, estructuras, funciones, errores.

- SQL base y extracción de datos.

- Proyecto: script que limpia datos y genera métricas con un README claro.

Semanas 4 a 6: datos serios y preparación para modelado

- Pandas, Numpy, joins y ventanas en SQL.

- Feature engineering simple y validaciones básicas.

- Proyecto: pipeline de datos con control de duplicados y logs.

Semanas 7 a 9: machine learning con evaluación

- scikit-learn, pipelines, métricas y validación.

- Análisis de errores y mejora iterativa.

- Proyecto: modelo con informe de fallos y propuesta de mejora.

Semanas 10 a 12: IA aplicada y portfolio

- RAG sencillo con documentos propios y trazabilidad interna.

- Evaluación con casos límite y mensajes de no sé cuando aplique.

- Proyecto final: app o API con logs y documentación reproducible.

Cómo convertir tecnologías en empleabilidad: el portfolio que sí te abre puertas

La mayoría de personas pierde tiempo aprendiendo tecnologías sin traducirlo a evidencia. En entrevistas, la pregunta real no es qué has estudiado. Es qué has construido, cómo lo mediste y qué aprendiste cuando falló.

Portfolio mínimo recomendado en 2026

- Proyecto de datos: pipeline con limpieza, modelo de datos y métricas claras.

- Proyecto de ML: modelo con evaluación, análisis de errores y mejoras.

- Proyecto de IA generativa: RAG con trazabilidad interna y suite de tests.

Conclusión

Qué tecnologías aprender para trabajar en IA se resume en una secuencia clara: programación y hábitos de ingeniería, datos y SQL, machine learning con evaluación, IA generativa con RAG y control de calidad, y operación con MLOps y seguridad básica.

Si quieres pasar de entender la teoría a liderar proyectos reales de IA, te recomiendo este Bootcamp Full Stack. Es la ruta más directa para dominar las herramientas que exige el mercado hoy: Bootcamp Inteligencia Artificial Full Stack Bootcamp.

Otros artículos que te pueden interesar

- Roadmap para aprender Python para IA

- Roadmap para aprender Data Engineering

- Qué es MLOps

- Roadmap para ser AI Engineer

- Data Scientist vs Machine Learning Engineer

- Python vs JavaScript para empezar a programar

Si quieres ampliar el contexto y comparar sus conclusiones con tu plan de aprendizaje para priorizar lo que más impacto tendrá en tu empleabilidad. leer la referencia del World Economic Forum.